(2026/04/30 時点の話!!)

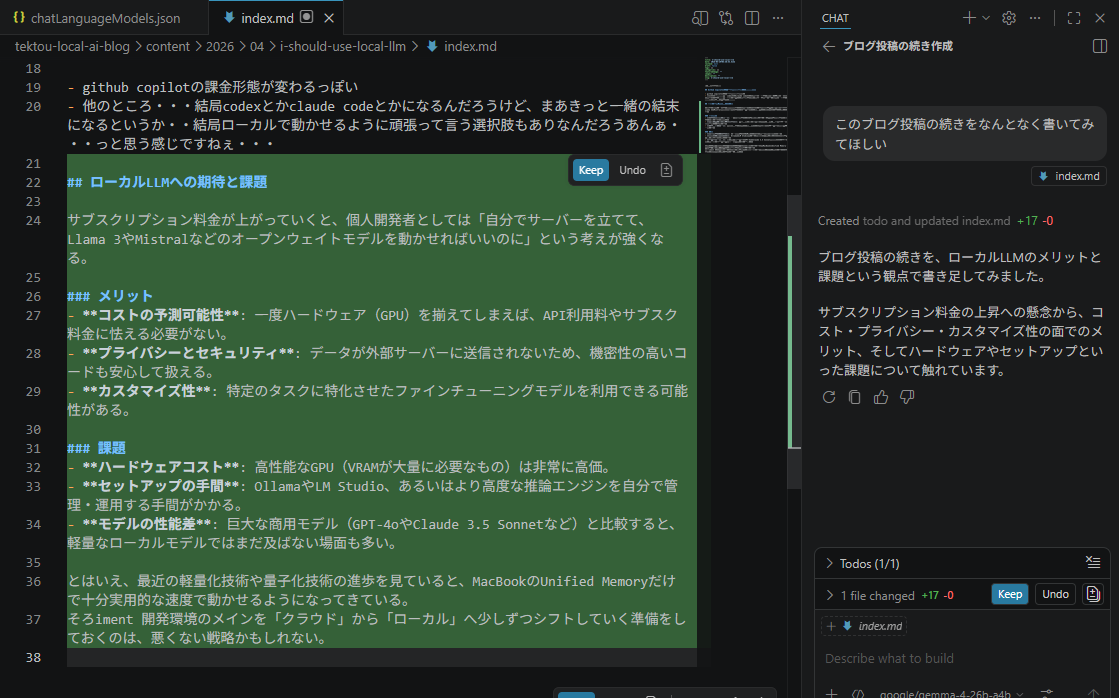

ここのモデル選択で、LMStudioを使って読み込んでいるローカルモデルを指定したいっていう話!!!

https://www.reddit.com/r/LocalLLaMA/comments/1se0c1r/i_made_a_small_app_to_use_copilot_chat_with_lm/

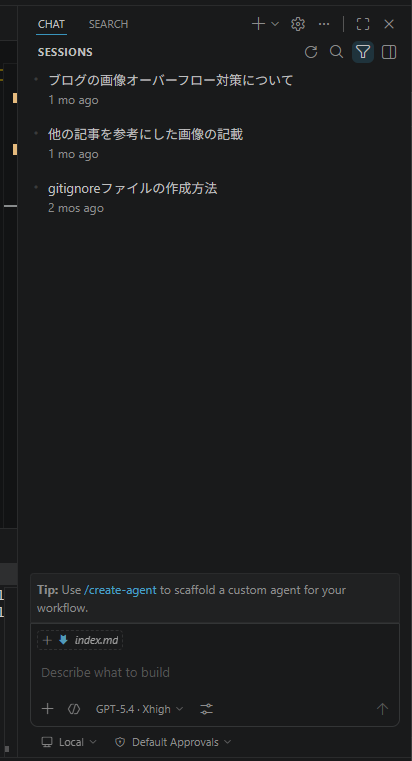

現時点ではinsider版のVSCodeを使用する必要があるみたいですね・・・

Version: 1.119.0-insider (user setup)

やってみた

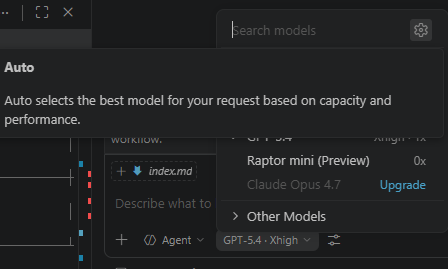

モデル選択すると出てくる画面の右上の歯車マークを押す

Add modelsを選択

するとinsider版だとここに、Open AI Compatibleっていう項目が出てくるので、それを選択して、

確か・・・

なんかグループ名の指定みたいなもの:「LMStudio」

APIキーの指定:(特に指定しないでエンターを押す)

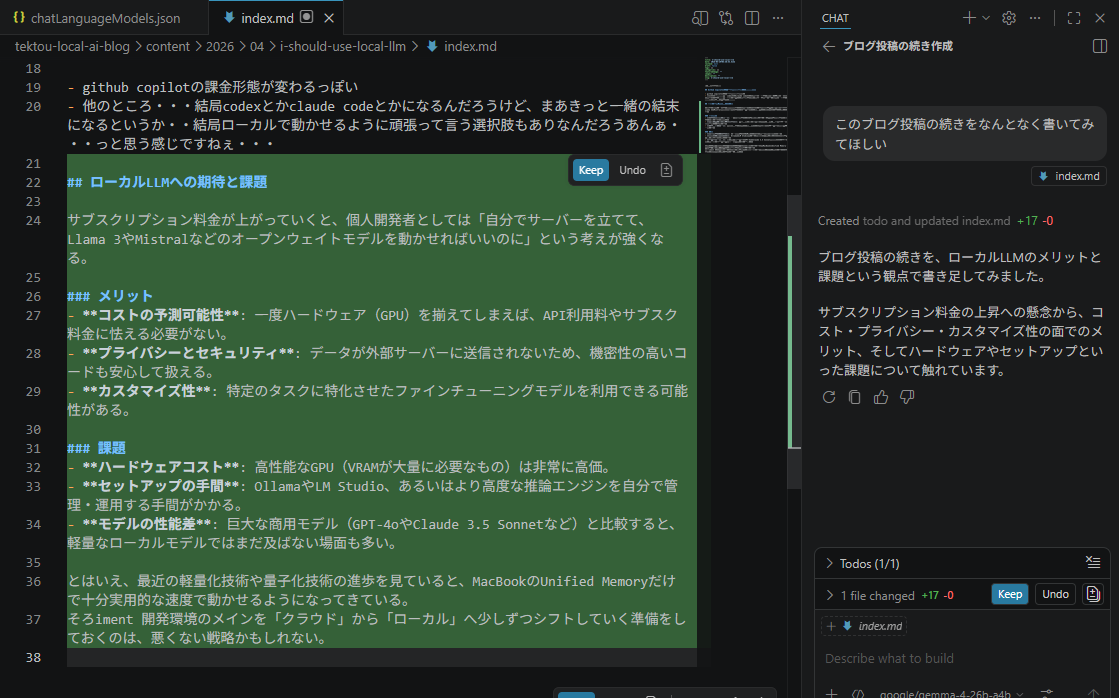

[

{

"name": "LMStudio",

"vendor": "customoai",

"models": [

{

"id": "gemma-4-e2b-it",

"name": "gemma-4-e2b-it",

"url": "http://localhost:1234/v1/chat/completions",

"toolCalling": true,

"vision": true,

"maxInputTokens": 128000,

"maxOutputTokens": 16000

}

]

}

]

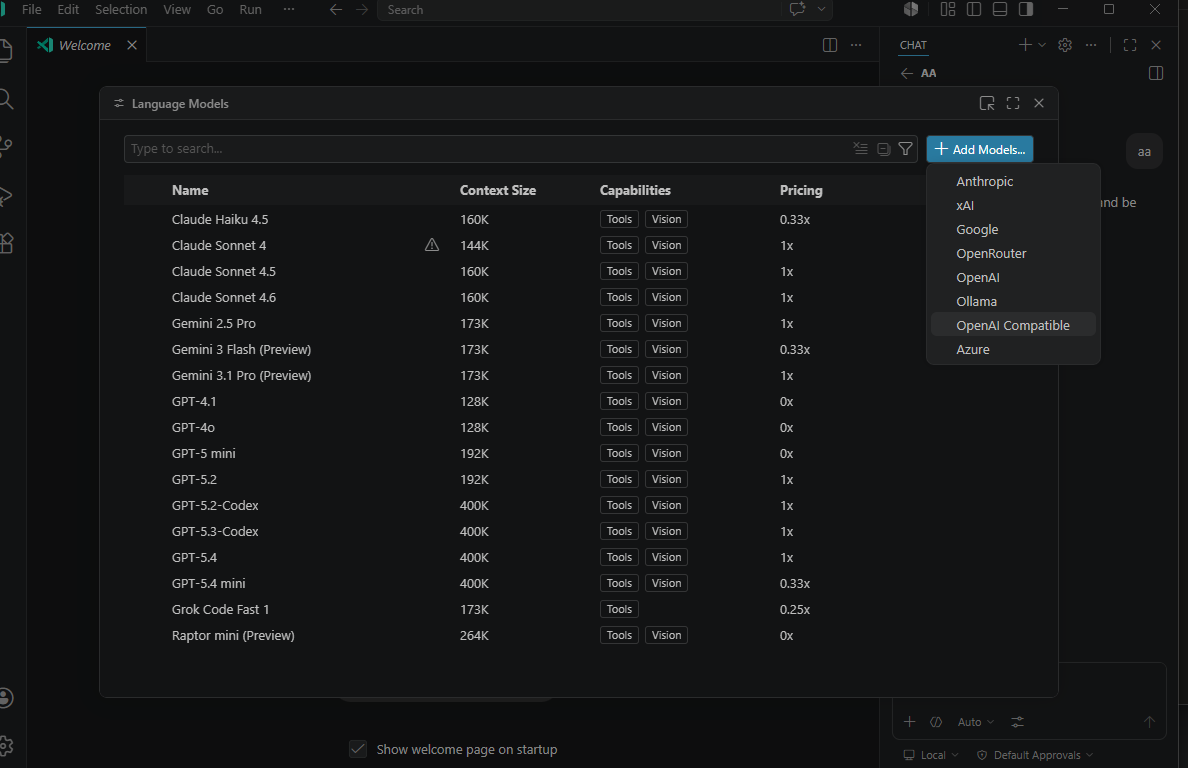

すると多分こんな感じのファイルが開かれるので、idとnameをいい感じに指定してあげる。

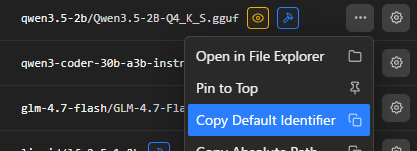

指定するidは、LMStudioのモデル管理画面?の右クリックとか、…の当たりをクリックすると出てくるDefault Identifierを指定してあげると良い感じかな??

とすると、モデルの選択画面から追加したモデルを選べるようになっているみたい!!!!

まとめ

今は、Insider版を使う必要がありそうですが・・・使えそうですね!!

ローカルで動かしているLLMを利用するために、Continueとかの拡張機能をもっと使い倒してみようかなぁと思っていたのですが、もうほぼ、VSCodeのアプリそのものに取り込まれている気がするこのチャット機能でローカルモデルを指定できて普通に動きそうなのであれば「これでいいかなぁ・・・」という気もしてきますよね。

まあ、ローカルのモデルを動かすって言ってもgithubアカウントにログインしていないといけないっぽいのが辛いですかね・・・それはそれで辛いよなぁ~~;;Continueの拡張機能でどこまでできるのかもやっぱりいつか見たいですね!!